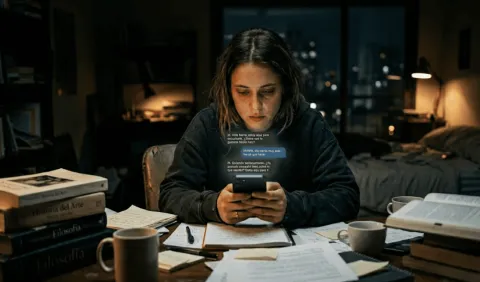

Ciudad de México, México.- Un estudio reciente en alertas sobre la creciente disposición de las personas a aceptar como válidas las respuestas de los chatbots de inteligencia artificial, incluso cuando son incorrectas, al anunciar un fenómeno que sus autores describen como una forma de “rendición cognitiva”.

La investigación, elaborada por Steven Shaw, investigador postdoctoral de la Universidad de Pensilvania, y por el profesor de marketing Gideon Nave, sostiene que muchos usuarios tienden a confiar en herramientas como ChatGPT, Gemini o Claude sin cuestionar suficientemente la veracidad de la información que reciben. El planteamiento surge en un contexto en el que estos sistemas se han incorporado con rapidez a la vida cotidiana, pese a seguir mostrando fallas importantes.

Como referencia, el texto recuerda que un estudio de la BBC difundido en octubre encontró que incluso los chatbots más avanzados ofrecieron respuestas incorrectas en el 45 por ciento de los casos analizados. A partir de ese escenario, Shaw y Nave desarrollaron una serie de experimentos para observar hasta qué punto los usuarios estaban dispuestos a seguir las sugerencias de la inteligencia artificial aun cuando no fueran precisas.

En esas pruebas, los participantes debían responder preguntas de razonamiento y conocimiento general, con la posibilidad opcional de apoyarse en ChatGPT. Más de la mitad decidió utilizar la herramienta, y los resultados mostraron una fuerte inclinación a seguir sus indicaciones. En el experimento más llamativo, realizado con 359 personas, los participantes aceptaron la recomendación correcta de la IA en 92.7 por ciento de los casos, pero también siguieron una respuesta equivocada en 79.8 por ciento de las ocasiones en que el sistema falló.

Los autores interpretaron ese comportamiento como una señal de que una parte importante de los usuarios está dispuesta a sustituir su intuición y su proceso deliberativo por la aparente autoridad de la máquina. En otras palabras, el uso de estos sistemas no solo facilita las tareas, sino que puede llevar a delegar el pensamiento mismo, con implicaciones más profundas en la forma de tomar decisiones.

Durante una participación en un pódcast de la Universidad de Pensilvania, Shaw afirmó que la posibilidad de externalizar el pensamiento no había sido estudiado con suficiente profundidad y demostró que el fenómeno plantea preguntas relevantes sobre la relación entre humanos e inteligencia artificial. En la misma línea, señaló que, cuando se activa esta “rendición cognitiva”, las personas no solo adoptan respuestas erróneas, sino que además tienden a confiar más en ellas.

La investigación también sugiere que el uso creciente de estas herramientas podría debilitar la capacidad de análisis crítico. Nave subrayó que verificar la información proporcionada por la IA es una habilidad cada vez más necesaria y advirtió que el riesgo no reside únicamente en que la tecnología mejore, sino también en que los seres humanos se acostumbran a depender cada vez más de ella.

Ambos investigadores coincidieron en que, a medida que la inteligencia artificial se integra más en la vida cotidiana y desaparecen algunas de las barreras tecnológicas actuales, la dependencia podría profundizarse. En ese escenario, advirtieron, la sociedad corre el riesgo de ceder progresivamente una facultad fundamental: la capacidad de pensar de manera autónoma.

Descubre todo sobre noticias Puebla y de todo México visitando nuestra página principal.

Foto Especial

Djs